“Sustitución del juez natural ante el uso irresponsable de herramientas de inteligencia artificial”

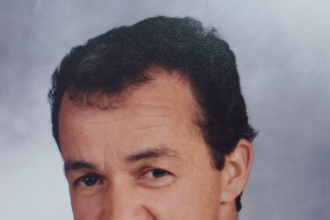

Por: Julio Cesar Orozco Franco*

La inteligencia artificial (IA) ha revolucionado múltiples sectores, desde la medicina hasta la educación, transformando la forma en que operan las instituciones y alterando las dinámicas laborales. Sin embargo, la adopción de estas herramientas en el ámbito legislativo plantea desafíos y dilemas éticos significativos, especialmente cuando se habla de la sustitución del juez natural.

El pasado 2 de diciembre, la sala penal del tribunal superior de Bogotá, declaró nula la sentencia emitida por una jueza de primera instancia el 23 de octubre de 2025 fundamentó en el uso indebido de inteligencia artificial en la motivación del fallo original. Esto ha revivido el debate sobre la imparcialidad y la transparencia en los procesos judiciales, este hecho resalta la existencia de un riesgo inherente en el uso irresponsable de tecnologías avanzadas en el juicio y la resolución de conflictos.

La figura del juez natural garantiza que cada individuo tenga su caso escuchado y decidido por un magistrado con la competencia y el conocimiento necesarios. Este principio se basa en la premisa de que los jueces, por su formación y experiencia, son los más capacitados para interpretar la ley, ponderar las evidencias y tomar decisiones justas. Al sustituir a estos profesionales por algoritmos, se corre el riesgo de deshumanizar el proceso judicial y, por ende, afectar gravemente los derechos de los ciudadanos.

Las decisiones tomadas por sistemas de IA se basan en grandes volúmenes de datos, pero a menudo carecen de un marco ético claro. Estos sistemas pueden perpetuar sesgos presentes en los datos históricos con los que fueron entrenados, llevando a resultados que no necesariamente reflejan la justicia. En un país como Colombia, donde la inequidad y la corrupción han sido temas centrales, una herramienta sesgada podría amplificar estas problemáticas. Además, la responsabilidad en la toma de decisiones es un elemento clave que se pierde en este proceso. Ante un fallo erróneo de un juez humano, existe un camino claro para la apelación y responsabilidad. Sin embargo, en el caso de decisiones automatizadas, la responsabilidad puede diluirse.

¿Quién responde cuando un algoritmo se equivoca? ¿El desarrollador, el juez que utilizó la herramienta o el sistema judicial en su conjunto? Estas preguntas aún no tienen respuestas definitivas. Por otro lado, la implementación de IA en el sistema judicial podría mejorar la eficiencia y agilidad de los procesos. La posibilidad de analizar datos judiciales masivos y ofrecer recomendaciones puede ser ventajosa en la preparación de casos. Sin embargo, estas herramientas deben ser utilizadas como apoyo y no como un reemplazo.

Es crucial que, en Colombia, las autoridades judiciales y legislativas establezcan un marco claro para la implementación de tecnologías de inteligencia artificial en el ámbito legal, garantizando que se respete el principio del juez natural. La capacitación continua de los jueces en el uso de estas herramientas es esencial para asegurar que se utilicen de manera responsable y ética.

*Especialista en Gerencia Informática, Ingeniero en Sistemas, Tecnólogo en electrónica, Instructor SENA G20, CCNP Encore y Advance ITR Cisco, Ciberops, ITEv8, CCNAv7, Python, PLC+HMI by Siemens, IOT, Amazon AWS, Auditor Ciberseguridad, ISO 27001 e ISO 22301 PMI & ITIL.